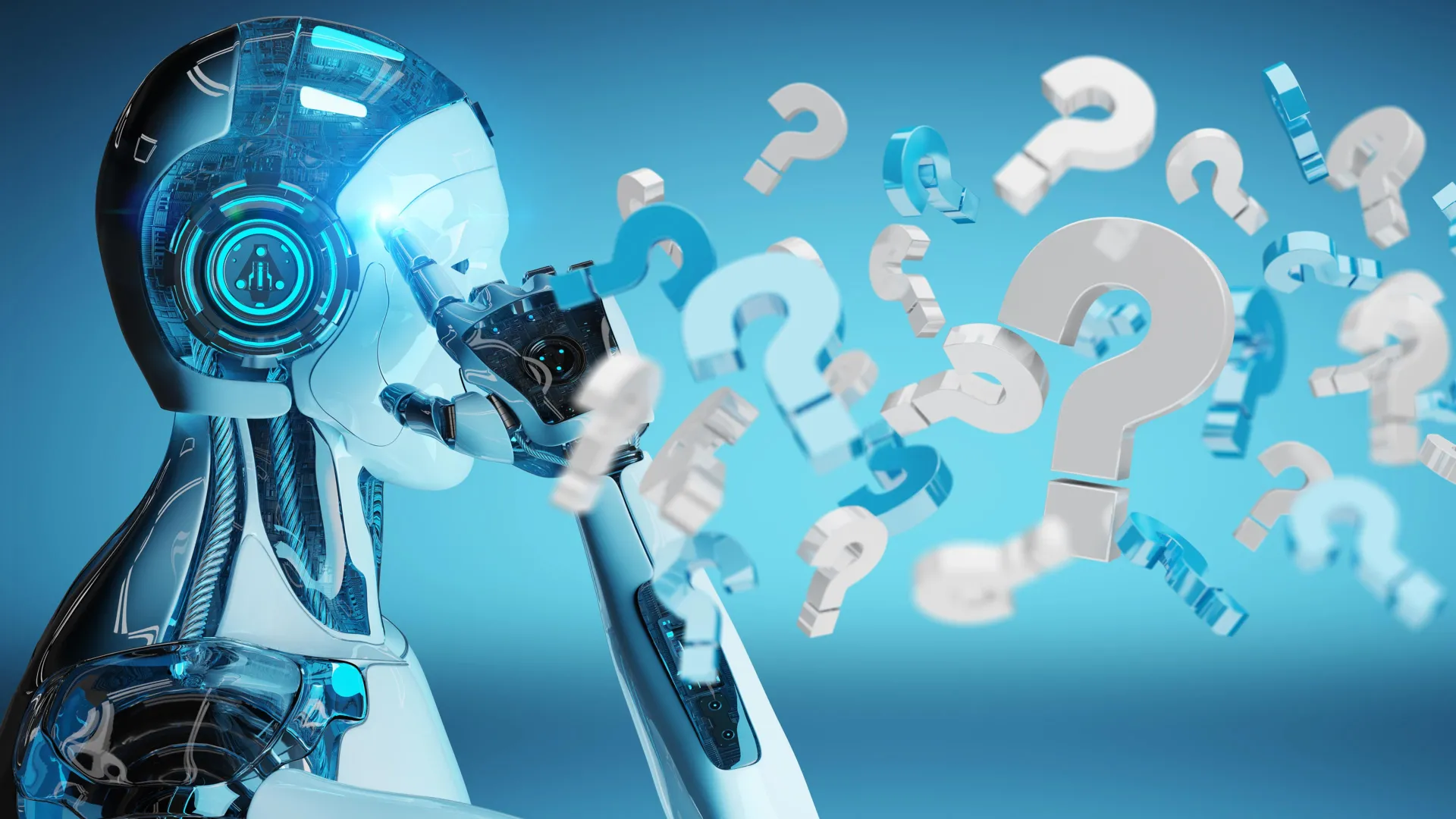

«ШІ вирішив», «ChatGPT знає», «алгоритм зрозумів» — ці фрази звучать щодня в новинах, офісних розмовах і наукових дискусіях. Здається, нічого небезпечного. Але дослідники з Університету штату Айова стверджують: такий спосіб говорити про штучний інтелект систематично формує хибне уявлення про природу цих систем. Як повідомляє ScienceDaily, команда Джо Маккевіч і Джинін Оун провела перший великомасштабний корпусний аналіз того, як медіа описують ШІ — і з’ясувала: антропоморфізм у ЗМІ рідший і тонший, ніж здається, але його вплив потенційно значний.

Що відомо коротко

- : Aune J.E., Baker M.J., Mackiewicz J., Smith J. «Anthropomorphizing Artificial Intelligence: A Corpus Study of Mental Verbs Used with AI and ChatGPT», Technical Communication Quarterly (2025/2026). DOI: 10.1080/10572252.2025.2593840.

- Автори: Університет штату Айова, Університет Бригама Янга, Університет Північного Колорадо.

- Корпус: News on the Web (NOW) — 20 млрд+ слів з англомовних новин 20 країн.

- Слово «needs» — найпоширеніше ментальне дієслово поряд зі словом «AI» (661 раз); «knows» з «ChatGPT» — лише 32 рази.

- Антропоморфізм у новинах рідший і нюансованіший, ніж у повсякденній мові.

- Але навіть рідкісні випадки утворюють спектр — від нейтральних до небезпечно людиноподібних.

Що це за явище

Антропоморфізм — приписування людських рис нелюдським об’єктам. Щодо ШІ це відбувається, коли ми кажемо «машина навчилась», «алгоритм зрозумів», «ChatGPT вирішив» — ніби вони мають наміри, свідомість або почуття.

Навіть провідні дослідники ШІ попереджають: сучасні системи не мають розуму, намірів або свідомості — це математичні моделі, що розпізнають патерни в даних. Але мова — потужний когнітивний інструмент. Слова формують модель світу в голові читача. І коли «ШІ знає» читається поруч з тим, що «людина знає» — межа між ними стирається.

Деталі відкриття

Команда проаналізувала, як ментальні дієслова (think, know, understand, need, want, decide, remember) поєднуються з термінами «AI» та «ChatGPT» у масиві новинного тексту з 20 країн. Головне несподіване відкриття: журналісти насправді досить обережні.

«Needs» лідирує — але переважно у нейтральних контекстах: «AI потребує великих обсягів даних», «AI потребує людської допомоги». Це технічні вимоги, а не людські потреби. Схожа логіка діє в реченнях на кшталт «машина потребує оливи» — ніхто не вважає машину живою. Пасивна конструкція «AI needs to be trained» (ШІ потрібно тренувати) навіть повертає відповідальність людині, а не машині.

Що показали нові спостереження

Разом з тим дослідники виявили спектр від нейтрального до насправді антропоморфного. Рубіж переходить у фразах на кшталт «AI needs to understand the real world» — тут «розуміння» вже несе конотації свідомого сприйняття, моральної позиції, людської логіки. Так само, як публікації про те, що «ШІ відчуває стрес», можуть вводити в оману навіть при поясненні, що йдеться про метафору, ці граничні випадки найбільш небезпечні.

Важливо: редакційні стандарти (зокрема, настанови AP, що забороняють приписувати ШІ людські риси) справді впливають на тексти — але не знімають проблему повністю.

Чому це важливо для науки

Вчені виокремлюють три практичних наслідки. Перший — завищені очікування: якщо ШІ «знає» і «вирішує», люди можуть переоцінити його надійність і покластися на нього там, де необхідне людське судження. Другий — розмивання відповідальності: коли ChatGPT «вирішив», де тоді розробник, компанія, замовник? Антропоморфна мова відволікає від реальних акторів. Третій — викривлення регуляторної дискусії: якщо ШІ вже «мислить», чи не варто надати йому права? Така логіка виникає природно з мовних звичок — і веде в сторону від реальних питань безпеки.

Цікаві факти

Психологи виявили, що люди схильні приписувати наміри будь-якому об’єкту, що рухається або реагує — це агентне сприйняття, еволюційно корисний механізм виявлення хижаків. Побачивши трикутник, що «переслідує» коло, люди негайно описують це як «агресію» або «бажання». ШІ активує той самий механізм — навіть коли це статистична модель.

Психологи виявили, що люди схильні приписувати наміри будь-якому об’єкту, що рухається або реагує — це агентне сприйняття, еволюційно корисний механізм виявлення хижаків. Побачивши трикутник, що «переслідує» коло, люди негайно описують це як «агресію» або «бажання». ШІ активує той самий механізм — навіть коли це статистична модель. Настанови Associated Press (AP Stylebook) прямо застерігають: не слід писати «ШІ думає» або «комп’ютер відчуває» — це неточна антропоморфізація. Але AP Stylebook регулює лише тих, хто його дотримується, а переважна більшість цифрового контенту про ШІ пишеться поза цими стандартами. Джерело: AP Stylebook 2025.

Настанови Associated Press (AP Stylebook) прямо застерігають: не слід писати «ШІ думає» або «комп’ютер відчуває» — це неточна антропоморфізація. Але AP Stylebook регулює лише тих, хто його дотримується, а переважна більшість цифрового контенту про ШІ пишеться поза цими стандартами. Джерело: AP Stylebook 2025. Корпус News on the Web (NOW) — один з найбільших відкритих корпусів природної мови у світі: понад 20 мільярдів слів з 2010 р. дотепер, оновлюється щомісяця. Він включає матеріали з газет і новинних сайтів у 20 країнах від Ганни до Японії. Джерело: English-Corpora.org.

Корпус News on the Web (NOW) — один з найбільших відкритих корпусів природної мови у світі: понад 20 мільярдів слів з 2010 р. дотепер, оновлюється щомісяця. Він включає матеріали з газет і новинних сайтів у 20 країнах від Ганни до Японії. Джерело: English-Corpora.org. Термін «антропоморфізм» щодо машин не новий: вже у 1966 р. творець комп’ютерного терапевта ELIZA Джозеф Вейценбаум був вражений тим, як швидко люди починали сприймати його програму як «живу» та довірялись їй — попри те, що вона лише відзеркалювала їхні фрази. ELIZA ефект живе досі.

Термін «антропоморфізм» щодо машин не новий: вже у 1966 р. творець комп’ютерного терапевта ELIZA Джозеф Вейценбаум був вражений тим, як швидко люди починали сприймати його програму як «живу» та довірялись їй — попри те, що вона лише відзеркалювала їхні фрази. ELIZA ефект живе досі.

FAQ

Чому взагалі люди антропоморфізують ШІ — це просто невігластво? Ні. Антропоморфізм — природний когнітивний процес: людський мозок еволюційно пристосований знаходити «агентів» і «наміри» навколо. Це стосується навіть тих, хто добре розуміє, як працює ШІ. Проблема не в невігластві, а в тому, що мова автоматично активує ці когнітивні шаблони — і їх важко свідомо відстежити.

Чи означає це, що слід уникати всіх слів на кшталт «навчається» або «розуміє» у контексті ШІ? Не обов’язково. Автори дослідження підкреслюють: питання в контексті і силі антропоморфізму. «AI навчається на даних» — технічно коректний опис процесу навчання. «AI розуміє вашу проблему» — вже потенційно оманливо. Ключ — усвідомленість у виборі слів і чіткий контекст.

Що відповідальні письменники і журналісти можуть зробити вже зараз? Дослідники рекомендують: замінювати «ШІ вирішив» на «розробники налаштували ШІ так, щоб»; уточнювати, хто стоїть за рішенням; обирати пасивні конструкції, що повертають відповідальність людям; і перечитувати матеріали з питанням «чи не приписую я машині свідомість або наміри?»

Думаєте, що штучний інтелект «знає», що робить? Вчені кажуть: подумайте ще раз з’явилася спочатку на Цікавості.

1969

1969