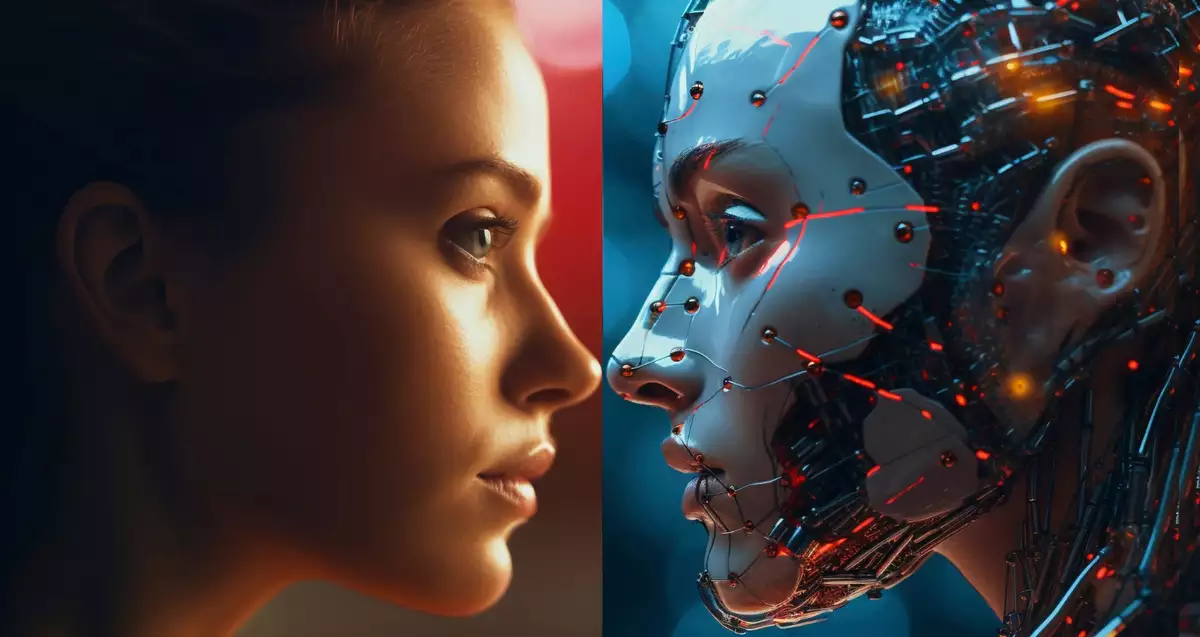

Поки у Лондоні в Королівському товаристві відбувалась конференція «Жінки і майбутнє науки», наукова журналістка Catherine de Lange зіткнулась із симптоматичним курйозом: її ШІ-транскрибатор систематично замінював ім’я «Джулі» на «Джуліан» — саме під час сесії про витіснення жінок зі сфери штучного інтелекту. Ця дрібниця точно відображає масштаб проблеми, яку провідні дослідники описують як одну з найсерйозніших у розвитку технологій XXI століття — і про яку New Scientist пише 16 березня 2026 року.

Що відомо коротко:

- Лише 25% студентів комп’ютерних спеціальностей у Великобританії — жінки

- Лише 2% венчурного капіталу у сфері технологій дістається жінкам

- Менш ніж 1% досліджень у сфері охорони здоров’я стосується жіночих хвороб

- Виконавчий наказ Трампа закликав прибрати з системи управління ризиками ШІ посилання на різноманітність, рівність та інклюзивність

- Учасниці конференції стверджують: ШІ без жінок — це не майбутня загроза, а теперішня реальність

Що таке «гендерний розрив даних»

Гендерний розрив даних — це системна недопредставленість жінок у наукових, медичних і технологічних дослідженнях, яка призводить до того, що технології й ліки розробляються переважно для чоловічого тіла й досвіду. Манекени для краш-тестів десятиліттями відтворювали чоловічу фізіологію — і статистика смертей жінок у ДТП була стабільно вищою. Офісні системи кондиціонування налаштовані на чоловічий метаболізм. Скафандри для астронавтів не підходили за розміром жінкам.

З приходом генеративного штучного інтелекту масштаб проблеми кратно збільшився. ШІ навчається на даних, що відбивають минуле — з усіма його упередженнями. Але тепер ці упередження вбудовуються у системи, які впливатимуть на освіту, медицину, ринок праці і управління.

Деталі відкриття

На конференції під головуванням комп’ютерної вченої Венді Голл кілька панелістів стверджували, що ШІ-сектор без жінок — це вже не гіпотетичний сценарій. «Я у світі фронтирного ШІ, і це світ ШІ без жінок», — заявила Рамман Чодхурі, дослідниця даних, колишній посланниця США з питань ШІ і очільниця напрямку етики у Twitter до його поглинання Ілоном Маском.

Чодхурі зараз очолює некомерційну організацію Humane Intelligence, що займається підзвітністю ШІ-систем. Вона вказала на одну з причин регресу: хибне відчуття надзвичайності. Якщо наратив навколо ШІ зводиться до екзистенційних ризиків для людства — «ваш будинок горить» — то все, що здається несуттєвим, зокрема й різноманітність розробників, відкидається як зайве. А саме ризики ШІ в освіті і без того недооцінені.

Дослідниця соціальних наслідків технологій Рейчел Колдікатт висловилась ще різкіше: «Якщо ми уявимо, як виглядає світ без жінок у ШІ — я думаю, це те, що у нас є прямо зараз».

Що показали нові спостереження

Окремий контекст надає Девід Леслі з Інституту Алана Тюрінга, відповідальний за дослідження в галузі етики та відповідальних інновацій: за останні два роки відбувся регрес. Указ президента США Трампа про «woke AI» фактично закликав вилучити з офіційного фреймворку управління ризиками ШІ посилання на дезінформацію, різноманітність та зміну клімату. «Питання про те, чи завдала адміністрація Трампа міжгенераційної шкоди жінкам у науці, — безперечне», — заявив Леслі.

Цей тиск накладається на й так несприятливу структуру Кремнієвої долини. Як ШІ гомогенізує мислення, так і сама індустрія ШІ гомогенізується — демографічно й ідейно, відтісняючи голоси, що ставлять під сумнів домінуючу парадигму.

Чому це важливо для науки

ШІ не є нейтральним інструментом — він відтворює і підсилює ті цінності, які вкладають у нього розробники. Якщо розробники є переважно чоловіками з WEIRD-культур (westernized, educated, industrialized, rich, democratic), система за замовчуванням обслуговуватиме їхній досвід.

Колдікатт закликає не «виправляти» поточні моделі — вона вважає це неможливим через сотні років упереджених даних, що в них закладені. Натомість потрібні альтернативні моделі, побудовані навколо інших пріоритетів: турботи про людей і планету замість максимізації залученості й прибутку.

Леслі, у свою чергу, наполягає: потрібно трансформувати економічні стимули. Доки прибуток і швидкість залишаються єдиними мірилами прогресу, різноманітність у розробці ШІ залишатиметься гаслом, а не реальністю. А вже гомогенізація мовних моделей є наслідком саме такої монокультурної розробки.

Цікаві факти

Дартмутська конференція 1956 року. Саме поняття «штучний інтелект» виникло на Дартмутській конференції у США у 1956 році. Серед запрошених не було жодної жінки. «Визначення інтелекту бере початок із Дартмутської конференції. Яка, до речі, складалась виключно з чоловіків», — зауважила Венді Голл під час сесії. Ця обставина досі визначає базові концепції того, що вважати «розумним».

Дартмутська конференція 1956 року. Саме поняття «штучний інтелект» виникло на Дартмутській конференції у США у 1956 році. Серед запрошених не було жодної жінки. «Визначення інтелекту бере початок із Дартмутської конференції. Яка, до речі, складалась виключно з чоловіків», — зауважила Венді Голл під час сесії. Ця обставина досі визначає базові концепції того, що вважати «розумним».

Ліки, що не рятують жінок. Клінічні дослідження десятиліттями проводились переважно на чоловіках, через що оптимальні дози й побічні ефекти для жінок залишались невідомими. За даними Американської кардіологічної асоціації, симптоми інфаркту у жінок суттєво відрізняються від «класичних» — але медичні системи досі орієнтуються на чоловічу норму.

Ліки, що не рятують жінок. Клінічні дослідження десятиліттями проводились переважно на чоловіках, через що оптимальні дози й побічні ефекти для жінок залишались невідомими. За даними Американської кардіологічної асоціації, симптоми інфаркту у жінок суттєво відрізняються від «класичних» — але медичні системи досі орієнтуються на чоловічу норму.

Крива Кук’а ще гостріша в ШІ. Якщо у технологічних компаніях загалом жінки складають близько 26% працівників, то у спеціалізованих підрозділах з розробки ШІ їхня частка падає ще нижче — за даними Stanford HAI, лише ~13% дослідників ШІ є жінками.

Крива Кук’а ще гостріша в ШІ. Якщо у технологічних компаніях загалом жінки складають близько 26% працівників, то у спеціалізованих підрозділах з розробки ШІ їхня частка падає ще нижче — за даними Stanford HAI, лише ~13% дослідників ШІ є жінками.

Алгоритми, що «бачать» лише чоловіків. Дослідження показали, що деякі системи розпізнавання облич помиляються щодо жінок із темною шкірою у 34% випадків — проти менш ніж 1% для світлошкірих чоловіків (дослідження MIT Media Lab, Буоламвіні і Ґебру). Це не лише статистика — це вже реальні хибні арешти й відмови у доступі до послуг.

Алгоритми, що «бачать» лише чоловіків. Дослідження показали, що деякі системи розпізнавання облич помиляються щодо жінок із темною шкірою у 34% випадків — проти менш ніж 1% для світлошкірих чоловіків (дослідження MIT Media Lab, Буоламвіні і Ґебру). Це не лише статистика — це вже реальні хибні арешти й відмови у доступі до послуг.

FAQ

Чому ШІ «без жінок» — це проблема для всіх? ШІ дедалі більше визначає, хто отримує кредит, яке лікування пропонує медична система, яких кандидатів відбирають роботодавці. Якщо в навчальних даних і командах розробників домінує один демографічний тип — система відтворюватиме їхні переваги як «об’єктивну» норму. Наслідки торкаються всіх, але особливо вразливими є жінки, меншини і люди з нестандартними потребами.

Чи можна виправити упередження у вже існуючих моделях? Рейчел Колдікатт та ряд інших дослідників вважають, що ні — принаймні не в достатньому обсязі. Сотні років даних, відфільтрованих через чоловічу перспективу, занадто глибоко вкорінені. Реалістичніший шлях — розробка альтернативних моделей з іншими пріоритетами від самого початку, а не косметичне «виправлення» наявних.

Що конкретно можна змінити вже зараз? На думку Девіда Леслі, зміни мають починатись зі структурних стимулів: венчурне фінансування, критерії оцінки успіху, освітні програми. Рамман Чодхурі наголошує на підзвітності систем ШІ через незалежні аудити. А Колдікатт закликає переосмислити саму мету ШІ — від максимізації показників до турботи про людей і планету.

ШІ створюють майже без жінок і це небезпечно з’явилася спочатку на Цікавості.

1981

1981